- Intel·ligència ArtificialTecnologia

- 12 de maig de 2026

- Sense comentaris

- 10 temps de lectura

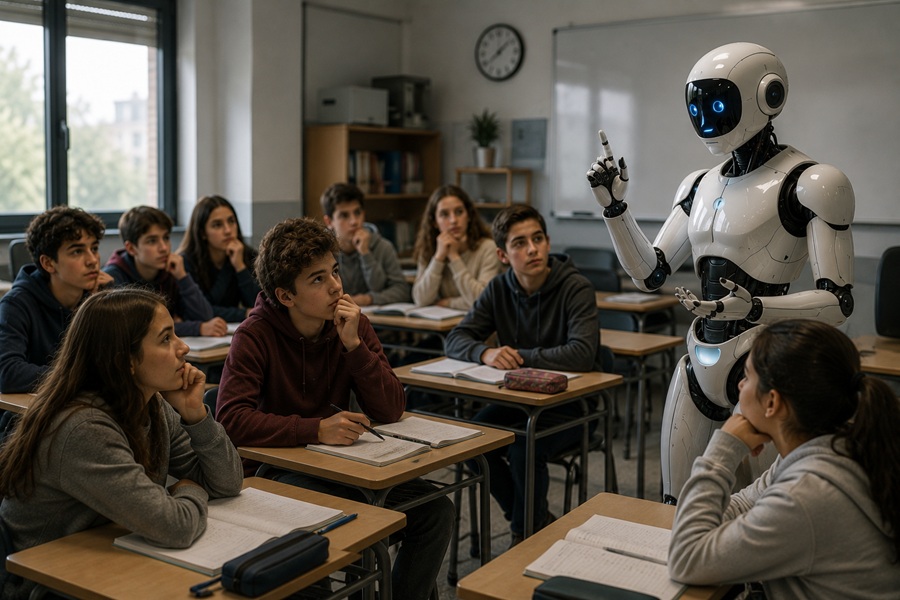

IA a l’ensenyament tècnic: el risc de la descàrrega cognitiva i el tempo com a deontologia

La nostra comunitat educativa porta temps debatent si cal incorporar la intel·ligència artificial (IA) a la docència. Però, en el context dels docents d’ensenyaments tècnics, donat que estem formant professionals en els sectors tecnològics, potser la pregunta pertinent no és si cal, sinó quan. I, al bell mig d’un entorn marcat per la pressió institucional i mediàtica per la innovació, en un mercat laboral molt competitiu, aquesta distinció és crucial.

Tal com he argumentat previament, la introducció de qualsevol tecnologia educativa no ha de ser una finalitat en si mateixa. Llevat de les matèries tecnològiques, o moments específics del currículum, on la tecnologia educativa és l’objecte d’estudi (cas d’algunes matèries dels nostres graus i màsters), la tecnologia és un mitjà. Però introduir-la abans que l’alumne hagi adquirit els marcs conceptuals necessaris és contraproduent: genera dependència instrumental, superficialitat a l’aprenentatge i un fals sentiment de comprensió. La pregunta que ens hem de fer, doncs, no és ‘ha d’usar la IA el meu alumne?’, sinó ‘ha après ja el suficient per poder-la usar críticament?’.

Hom veu clarament que donar una calculadora a un alumne de primària que encara no sap multiplicar és perjudicar el seu aprenentatge, i el seu desenvolupament del càlcul mental. El mateix passa amb els alumnes que, per exemple, estan aprenent els fonaments de la programació als nostres campus: emprar la IA com a drecera els perjudica. El tempo, el moment adequat d’introducció, és el primer criteri deontològic de qualsevol docent que vulgui usar la IA amb responsabilitat.

La descàrrega cognitiva de la IA generativa

El risc no és hipotètic. La recerca recent és inequívoca: quan els estudiants fan servir eines d’IA generativa com a drecera, no aprenen, o aprenen menys. El fenomen té nom tècnic: cognitive offloading, o descàrrega cognitiva (Risko & Gilbert, 2016). Es produeix quan l’estudiant externalitza a la màquina les operacions mentals que hauria de fer ell: recuperació, síntesi, raonament, planificació, creativitat, pensament crític. A curt termini, els resultats poden semblar millors; a mig i llarg termini, el pensament de nivell superior —el que esquematitza, per exemple, la Taxonomia de Bloom— es veu compromès (Gerlich, 2025).

La IA generativa és, literalment, fluïdesa a demanda. I el problema és que les tasques difícils —les desirable difficulties de la literatura pedagògica— són precisament les que consoliden l’aprenentatge, especialment a la universitat. Quan l’alumne els esquiva, pot obtenir una bona nota emprant les dreceres de la IA, però no construeix competència real. S’ha documentat fins i tot que l’ús prolongat d’IA sense regulació porta a un declivi en la retenció de la memòria i en la qualitat del raonament (Lodge & Loble, 2026). Fan et al. (2025) han encunyat el terme metacognitive laziness (vagància metacognitiva) per descriure com la comoditat de la IA pot erosionar els processos autoreguladors essencials per a qualsevol aprenentatge profund.

El repte educatiu és, doncs, doble: evitar que la IA es converteixi en una pròtesi cognitiva permanent, i crear al mateix temps un clima d’aula on l’alumne pugui ser honest sobre el seu ús de la tecnologia. La honesta autoavaluació (He après? Entenc i/o sabria fer jo el que ha generat la màquina?) és una competència que cal ensenyar explícitament, en especial en la formació tècnica que impartim a la UPC.

El codi deontològic docent: la tecnologia com a responsabilitat professional

La majoria del professorat desconeix que existeix un Codi Deontològic Docent (CDD) que hauria d’orientar la seva pràctica professional. El Col·legi Oficial de Doctors i Llicenciats en Filosofia i Lletres i en Ciències de Catalunya va aprovar el 2021 un CDD que incorpora de manera explícita el compromís del professorat amb l’ús responsable i ètic de la tecnologia (Hernández-Fernández, 2025). Això no és anecdòtic: és el reconeixement que cada decisió tecnològica a l’aula té conseqüències sobre la formació dels professionals que forgem a classe, i també de retruc sobre la ciutadania, la privadesa, l’autonomia personal de l’alumnat i l’equitat educativa.

En el context educatiu, aquest compromís s’hauria de concretar en obligacions ben definides: actualitzar les competències digitals pròpies, conèixer la normativa sobre protecció de dades, prevenir el plagi, analitzar els biaixos algorítmics i els interessos corporatius de les eines que es proposen a l’alumnat, i garantir la confidencialitat de la informació acadèmica. Però, sobretot, implica quelcom de més profund: posar la tecnologia al servei de l’aprenentatge, i no a l’inrevés. Cal per això una revisió exhaustiva de les activitats que demanem als alumnes: es poden fer a cop de clic? Quines activitats plantejo que millorin el seu aprenentatge, donat el context actual?

L’ús de la IA a l’aula no és opcional ni exclusiu del professorat de disciplines tècniques. Afecta tot el claustre, totes les àrees. Potser tenim, per ara, alguna excepció que confirma la norma. Però la deontologia, dissortadament, continua absent tant a la formació inicial i continua del professorat, com a les lleis educatives i, encara pitjor, a la reflexió de bona part del professorat.

A mode de conclusió

Cal incorporar el tempo com a criteri pedagògic i el codi deontològic com a marc professional. Valorar què guanyem i també què es pot perdre amb la IA a l’aula, i els riscos, cas de la descàrrega cognitiva esmentada aquí. Significa, paradoxalment, no emprar la IA de forma anecdòtica o gratuïta, com a moda, donat el conegut impacte ambiental i didàctic que hi té: cal integrar-la a les disciplines de forma pragmàtica, meditada, útil i crítica per a una pràctica professional actualitzada, pensant en el present i sobre tot en el futur del nostre estudiantat. Vol dir doncs educar en les seves conseqüències ambientals, socials, tecnoètiques i cognitives. I implica crear les condicions perquè l’alumne aprengui de debò, amb esforç productiu, amb la màquina com a reforç i agent de millora i acompanyament, no únicament com a eina de descàrrega cognitiva o drecera per a fer tasques i aprovar.

El pensament crític a la docència passa per dubtar d’incorporar tecnologies sense rumiar bé el seu impacte a l’aprenentatge: apliquem a la IA el principi de prudència de la Declaració de Barcelona (Steels & López de Mantaras, 2018). Perquè a l’ensenyament, en general, és millor tenir evidències del que apliquem a classe, i en aquest sentit, com se sol dir, en educació és millor estar a la penúltima que a la última.

Referències:

Fan, Y., Tang, L., Le, H., et al. (2025). Beware of metacognitive laziness: Effects of generative artificial intelligence on learning motivation, processes, and performance. British Journal of Educational Technology, 56(2), 489–530. https://doi.org/10.1111/bjet.13544

Gerlich, M. (2025). AI tools in society: Impacts on cognitive offloading and the future of critical thinking. Societies, 15(1), 1–28. https://doi.org/10.3390/soc15010006

Hernández-Fernández, A. (2026, 28 de gener). When to use technology in the classroom. Educational Evidence. https://educationalevidence.com/en/when-to-use-technology-in-the-classroom/

Hernández-Fernández, A. (2025). Tecnologia, tecnoètica i codi deontològic docent. Revista de tecnologia», 13, p. 56-59. http://hdl.handle.net/2117/442517

Lodge, J. M., & Loble, L. (2026). Artificial intelligence, cognitive offloading and implications for education. Network for Quality Digital Education / University of Technology Sydney. https://www.uts.edu.au/news/2026/03/experts-warn-unstructured-ai-use-in-schools-risks-cognitive-atrophy

Risko, E. F., & Gilbert, S. J. (2016). Cognitive offloading. Trends in Cognitive Sciences, 20(9), 676–688. https://doi.org/10.1016/j.tics.2016.07.002

Steels, L., & López de Mantaras, R. (2018). The Barcelona declaration for the proper development and usage of artificial intelligence in Europe. AI communications, 31(6), 485-494. http://doi.org/10.3233/aic-180607

Font: educational EVIDENCE

Drets: Creative Commons